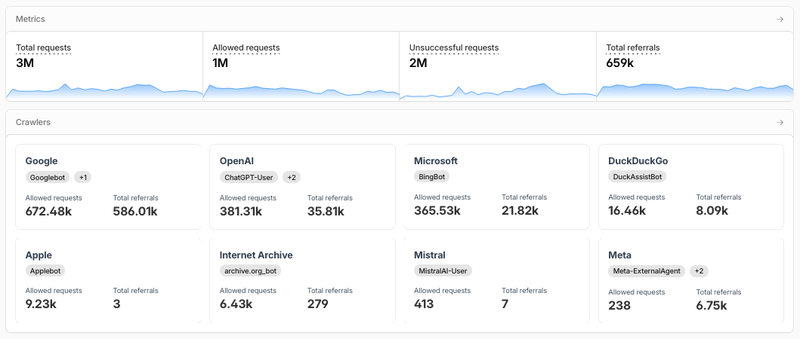

En las últimas semanas, el sitio web de openDemocracy quedó fuera de línea varias veces, como si estuviera bajo ataque. Una de las causas fue una colosal avalancha de bots automatizados provenientes de empresas de inteligencia artificial (IA).

A medida que más personas recurren a chatbots y otros modelos de lenguaje de gran tamaño (LLM, por sus siglas en inglés) en lugar de buscar información o visitar directamente los sitios, las empresas de IA emplean rastreadores masivos para extraer los datos que alimentan sus servicios.

Muchos de estos rastreadores, en realidad extractores de datos, son tan sofisticados que resulta difícil, sin imposible, detectarlos en acción. A menudo ignoran las solicitudes programáticas de los sitios web de no ser rastreados y se sabe que golpean repetidamente las partes más frágiles de un sitio web.

Este movimiento en pinza de la IA diezma el tráfico hacia los medios de comunicación, al tiempo que socava nuestra capacidad de atender el tráfico que sí recibimos debido a estas operaciones de extracción a escala gigante.

Grant Slater es desarrollador principal de OpenStreetMap.org, una herramienta de mapas en línea creada por cartógrafos de todo el mundo, que contribuyen y mantienen datos sobre carreteras, senderos, cafés, estaciones y más. Slater dijo a openDemocracy que notó un aumento “drástico” de los rastreadores en los últimos dos años, hasta el punto de que OpenStreetMap está ahora “en guerra constante” con ellos.

“Suponemos que están extrayendo datos para alimentar LLM de IA o start-ups creadas para abastecer de datos de entrenamiento a las compañías de IA. En la web se está desarrollando una carrera silenciosa: proyectos de interés público están siendo afectados por la extracción industrial a gran escala de la IA”, dijo.

Slater explicó que “el tráfico suele llegar a través de IP (direcciones de internet) residenciales anónimas”, esto es redes de proxies (intermediarios) que enrutan el tráfico de internet utilizando IP reales que los proveedores de internet dan a los hogares. Esto hace difícil “distinguir a los ‘usuarios normales’ de la recopilación automatizada”.

“Nos están forzando a un estado de defensa permanente. Las redes de proxies residenciales permiten a los rastreadores de IA ocultarse a plena vista, cambiar de identidades y extraer datos a gran escala. Eso impone costos reales a proyectos que existen para servir a las personas, no para alimentar procesos de entrenamiento.

“Los rastreadores pueden rotar direcciones indefinidamente para extraer la mayor cantidad posible de datos para el entrenamiento de LLM, mientras que nosotros contamos con ancho de banda, capacidad de procesamiento y tiempo de voluntariado limitados. El resultado es una guerra de desgaste que no elegimos, en la que mantener el sitio operativo se convierte en una lucha constante”.

Otra preocupación, en la creciente lista de motivos para inquietarse por la IA, son los recursos necesarios para mantener a raya a estos invasores. Es posible que pronto los sitios web se vean obligados a exigir pruebas estrictas de humanidad a todos los visitantes, por ejemplo, requiriendo que los usuarios inicien sesión.

“Quienes obtienen el mayor beneficio de la extracción a gran escala están, en gran medida, protegidos de los costos que genera, que recaen sobre los editores. Estos se ven obligados a restringir el acceso para poder subsistir”, escribió la investigadora Audrey Hingle en su artículo Getting bots to respect boundaries (Lograr que los bots respeten límites).

“Con el tiempo”, dijo Hingle, “se corre el riesgo de acelerar el proceso de cierre: más contenido protegido por muros de acceso, acceso más limitado y una web en la que resulta más difícil participar”.

Cuida tu dieta informativa

El avance de la IA afecta la forma en que las personas se informan, ya que muchas acuden a chatbots para obtener noticias y realizar otras consultas generales.

Los agentes de IA, en sus distintas formas, han llegado para quedarse y harán que ciertos aspectos de la provisión de noticias sean más personalizados y detallados. Sin embargo, las grandes empresas que lideran este proceso están motivadas por intereses comerciales; ChatGPT ya ha comenzado a incorporar anuncios en sus productos.

La toxicidad de las redes sociales, donde el diseño está determinado por imperativos financieros, es un precedente preocupante de lo que podría ocurrir con la IA. Las alucinaciones, el engaño, la propaganda y la adulación interesada, rasgos por los que se conoce a los chatbots, también enturbiarán el panorama.

Mientras la confianza ante lo que está publicado en línea se vuelve cada vez más frágil, los usuarios deben actuar con criterio para asegurarse de obtener información precisa de fuentes honestas, examinar el origen de las noticias y consolidar vínculos directos con organizaciones respetadas, por ejemplo mediante las newsletters que les llegan a su correo electrónico, como las de demcraciaAbierta.

Tan importante como vigilar la manera en que los chatbots configuran su dieta informativa es controlar qué datos personales estamos dispuestos a ceder. La era de la IA prolonga la lógica del capitalismo de vigilancia: la información del usuario sigue siendo el producto. Hoy las empresas pueden conocer más que nunca sobre cada persona, dado el nivel de profundidad y alcance de las interacciones con los bots de IA.

Con esto en mente, Tony Curzon Price, ex editor en jefe de openDemocracy, lanzó la First International Data Unión (FIDU, Primera Unión Internacional de Datos) para permitir que las personas utilicen LLM sin que operadores como OpenAI acaparen datos valiosos provenientes de esas conversaciones.

“Nuestros datos, utilizados tanto para nuestro beneficio personal como para el colectivo, son el único punto de control que la ciudadanía posee frente al poder de las plataformas y de la gran industria de la IA. Creé la FIDU para que actúe como el custodio confiable de los intereses de sus miembros en el ciberespacio”, explicó Curzon Price. “La rápida expansión de la IA en la web hace aún más urgente establecer contrapesos efectivos frente a la extracción de datos con fines de lucro a escala planetaria por parte de los laboratorios de IA”.

Cabe esperar que innovaciones como esta otorguen al público mayor control sobre lo que la IA hace en sus vidas.

Supervisión y resistencia

Es posible reconocer los beneficios que pueden aportar los sistemas de IA y, al mismo tiempo, considerar que sus efectos negativos podrían superar a los positivos.

La competencia por ganar la carrera de la IA ya está generando múltiples resultados perjudiciales. Desde la expansión de centros de datos ambientalmente destructivos, hasta el uso de la IA para la pedofilia u otros abusos sexuales, pasando por “bots terapéuticos” problemáticos y la posible sustitución de seres humanos en la sociedad en general, los efectos son alarmantes y se desarrollan con rapidez.

Incluso los líderes del sector que se preocupan por las consecuencias se ven arrastrados por esta dinámica orientada a producir superinteligencia, que es al mismo tiempo una disputa estratégica de seguridad nacional y una competencia comercial. Ni siquiera existe un punto final claro en esta carrera, aunque algunos han imaginado posibles escenarios.

Mientras tanto, la ciudadanía activa debe ejercer presión política para asegurar que la industria no contamine en exceso, no provoque el próximo colapso financiero ni envenene las fuentes de información pública.

De momento, mi consejo es mantener la independencia y conservar vínculos con medios en los que confías, al margen de plataformas corporativas de dudosa integridad.

Sigue a openDemocracy y a democraciaAbierta directamente en la web abierta a través de su newsletter en español.

*Traducción de Angelina de los Santos